Il volto umano è potenziato, a seconda di come li conti, tra i 23 e i 43 muscoli, molti dei quali si attaccano alla pelle, senza alcuna funzione ovvia per la sopravvivenza. Un alieno che esamina un esemplare umano in isolamento non saprebbe cosa farne. Tirando su fronte, sopracciglia, labbra e guance, i muscoli trasmettono una grande quantità di informazioni sul nostro stato emotivo, livello di interesse e vigilanza. È un mezzo di comunicazione straordinariamente efficiente - quasi istantaneo, di solito accurato, che trascende la maggior parte delle barriere linguistiche e culturali. Ma a volte i dati vengono persi, ignorati o male interpretati. Se un taglialegna sorride nella foresta senza nessuno intorno a vederlo, era davvero felice?

Da questa storia

[×] CHIUDI

Emoticon così lunghe. Lo scienziato sta sviluppando una tecnologia in grado di rilevare e leggere le nostre espressioni

Video: Smithsonian Ingenuity Awards 2015: Rana el Kaliouby

Letture correlate

Intelligenza emotiva: perché può interessare più del QI

AcquistareRana el Kaliouby odia vedere che le informazioni vanno sprecate. Incontrando El Kaliouby nel suo piccolo ufficio a Waltham, nel Massachusetts, la vedo contrarre il suo muscolo zigomatico maggiore, sollevare gli angoli della bocca e il suo orbicularis oculi, increspare gli angoli esterni dei suoi occhi. Sta sorridendo e deduco che mi sta accogliendo, prima ancora di pronunciare la parola "ciao". Ma oggi molti scambi sociali avvengono senza interazione faccia a faccia in tempo reale. Ecco dove entrano el Kaliouby e la sua compagnia.

El Kaliouby, che ha 37 anni, sorride spesso. Ha un viso rotondo, piacevole, espressivo e un modo sollecito, che conferma la sua posizione di co-fondatrice di una start-up tecnologica in rapida crescita: un anti-Bezos, un non-Zuckerberg. La sua azienda, Affectiva, che ha fondato nel 2009 con un collega del MIT Media Lab, Rosalind Picard, occupa una posizione all'avanguardia nella tecnologia per utilizzare i computer per rilevare e interpretare le espressioni facciali umane. Questo campo, noto come "elaborazione affettiva", cerca di colmare il divario comunicativo tra esseri umani e macchine aggiungendo una nuova modalità di interazione, incluso il linguaggio non verbale di sorrisi, sorrisi e sopracciglia sollevate. "La premessa di ciò che facciamo è che le emozioni sono importanti", afferma el Kaliouby. “Le emozioni non interrompono il nostro pensiero razionale, ma lo guidano e lo informano. Ma mancano della nostra esperienza digitale. Lo smartphone sa chi sei e dove sei, ma non sa come ti senti. Miriamo a risolverlo. "

Perché il tuo smartphone deve sapere come ti senti? El Kaliouby ha una miriade di risposte, tutte basate sull'integrazione apparentemente sconfinata dei computer nelle routine della nostra vita quotidiana. Immagina "la tecnologia per controllare l'illuminazione, la temperatura e la musica nelle nostre case in risposta ai nostri umori" o app in grado di adattare il contenuto di un film in base alle tue reazioni inconsce ad esso mentre guardi. Immagina programmi in grado di monitorare la tua espressione mentre guidi e avverti di disattenzione, sonnolenza o rabbia. Sorride alla menzione della sua idea preferita: "un frigorifero che può percepire quando sei stressato e blocca il gelato".

In particolare, pensa Affectiva, e la tecnologia che sta aiutando a introdurre il mainstream, sarà un vantaggio per l'assistenza sanitaria. Un ricercatore che verifica un nuovo farmaco o un terapista che tratta un paziente, riceve feedback solo a intervalli, soggetti a tutti i problemi di auto-segnalazione, ad esempio il desiderio inconscio di piacere al medico o un richiamo selettivo che favorisce i ricordi più recenti . El Kaliouby prevede un programma in esecuzione sullo sfondo del laptop o del telefono del soggetto in grado di compilare una registrazione momento per momento del suo umore nel corso di un periodo di tempo (un giorno, un mese) e correlarlo al tempo o qualsiasi altra cosa il tuo dispositivo può misurare o tracciare. "Non dovrebbe nemmeno essere parte di un programma di trattamento", riflette. "Potresti semplicemente averlo sul tuo telefono e ti dice, ogni volta che le chiamate 'X' hai un'espressione negativa, e questo ti dice qualcosa che potresti non aver conosciuto."

Abbonati alla rivista Smithsonian ora per soli $ 12

Questa storia è una selezione dal numero di dicembre della rivista Smithsonian.

AcquistareEl Kaliouby promuove il calcolo affettivo come il logico passo successivo nella progressione da tastiera a mouse, da touchscreen a riconoscimento vocale. In primavera, Affectiva ha rilasciato il suo primo kit di sviluppo software commerciale, che gli sviluppatori, interessati agli stati emotivi in tempo reale degli utenti, possono incorporare nei propri programmi, ad esempio lettori musicali o app di gioco o di appuntamenti. E proprio in questo autunno Affectiva ha lanciato Emotion As a Service, un programma basato su cloud in cui i clienti possono caricare video per l'analisi. Chi potrebbe usarlo? Un candidato che sta per essere intervistato per un lavoro, che è preoccupato di apparire ansioso o annoiato o addirittura sorridere troppo. O una compagnia aerea che assume assistenti di volo, con centinaia di applicazioni video da esaminare alla ricerca di coloro che riescono a gestire un sorriso convincente mentre salutano i passeggeri. (Un sorriso genuino, che comporta una contrazione dei muscoli agli angoli degli occhi, è chiamato un sorriso "Duchenne", chiamato per l'anatomista del 19 ° secolo; il suo contrario, un sorriso forzato che usa solo la bocca, in realtà a volte è chiamato un sorriso "Pan Am".)

E, naturalmente, i dispositivi che eseguono questo software sono tutti connessi a Internet, in modo che le informazioni che raccolgono siano istantaneamente aggregate, setacciate e collegate in rete nel modo in cui le app di social media identificano argomenti o personalità popolari. Compilato, forse, in qualcosa come un indice dell'umore Affectiva, una lettura numerica sulla felicità nazionale lorda o suddiviso in regioni in cui i sorrisi o le sopracciglia sono attualmente di tendenza.

Il programma di base di Affectiva analizza il viso 20 volte al secondo per 46 espressioni localizzate di felicità, tristezza, sorpresa, paura, rabbia, disgusto e disprezzo, oltre a interesse e confusione. (Naomi Shavin / Smithsonian)

Il programma di base di Affectiva analizza il viso 20 volte al secondo per 46 espressioni localizzate di felicità, tristezza, sorpresa, paura, rabbia, disgusto e disprezzo, oltre a interesse e confusione. (Naomi Shavin / Smithsonian) Fino ad ora, i principali clienti di Affectiva sono stati società di pubblicità, marketing e media. Il suo software automatizza il processo di gestione di un focus group, il rituale ingombrante di riunire una dozzina di persone in una stanza per esprimere le loro opinioni su un nuovo prodotto, serie TV o campagna pubblicitaria; registra direttamente le reazioni, senza che un partecipante debba modificare il quadrante o rispondere a un questionario in risposta a una presentazione. Inoltre, il software espande il potenziale focus group in tutto il mondo, o almeno nella parte sostanziale di esso che ha un computer o dispositivo mobile abilitato per la webcam.

Il feedback dell'occhio implacabile e onnicomprensivo di Affectiva ha contribuito a plasmare una sitcom televisiva di rete, consegnando due personaggi all'oblio per il peccato di non far sorridere gli spettatori. (El Kaliouby non identificherà lo spettacolo né i personaggi.) Il suo software è stato utilizzato per costruire un "campionatore di sorrisi", una macchina che distribuiva barrette di cioccolato agli acquirenti che sorridevano nella sua macchina fotografica. Con ulteriori ricerche, potrebbe essere utile per la sorveglianza della folla negli aeroporti o per identificare potenziali taccheggiatori o come rilevatore di bugie.

Ma el Kaliouby ha resistito a queste applicazioni surrettizie, per quanto redditizie possano essere. Pensa che il calcolo affettivo cambierà il mondo, incluso, ma non solo, la vendita di barrette di cioccolato. "L'etica della nostra azienda", afferma, "è utilizzare questa tecnologia per migliorare la vita delle persone e aiutarle a comunicare meglio, non solo per aiutare gli inserzionisti a vendere più prodotti".

**********

A differenza di molti imprenditori tecnologici, diventare ricchi non era nell'agenda originale di el Kaliouby. Nata al Cairo da genitori egiziani che lavorano entrambi nella tecnologia, ha studiato informatica all'università americana al Cairo, dove si è laureata nel 1998, quando i computer stavano diventando abbastanza potenti da consentire ai ricercatori di pensare di dotarli di ciò che in termini umani è chiamato intelligenza emotiva.

Ha continuato a studiare informatica all'Università di Cambridge, arrivando subito dopo gli attacchi all'America dell'11 settembre 2001. I suoi genitori pensavano che avrebbe rischiato di essere arrestata, molestata o peggio a causa della sua eredità. Ma sebbene abbia indossato una copertura musulmana fino a un paio di anni fa, né a Cambridge, in Inghilterra, né a Cambridge, nel Massachusetts, dove si è trasferita nel 2006, per unirsi al MIT Media Lab, è mai stata preoccupata della sua religione o aspetto . "Penso che sia perché sorrido molto", dice sorridendo.

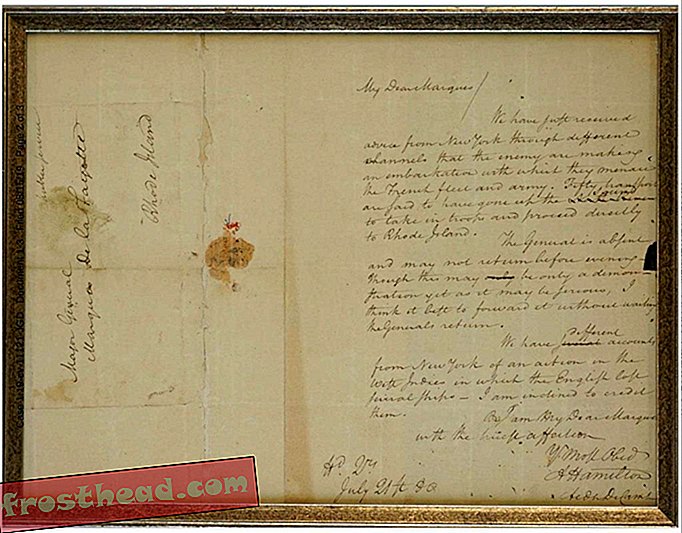

L'anatomista francese Duchenne ha pubblicato studi di riferimento sulle espressioni facciali umane. (Immagini Bridgeman)

L'anatomista francese Duchenne ha pubblicato studi di riferimento sulle espressioni facciali umane. (Immagini Bridgeman) Mentre era a Cambridge, si era interessata al problema dell'autismo, in particolare alla difficoltà dei bambini autistici nella lettura delle espressioni facciali. Ha proposto di costruire un "apparecchio acustico emotivo" che possa essere indossato per leggere i volti e suggerire comportamenti appropriati a chi lo indossa. Rifiutato inizialmente per una sovvenzione da parte della National Science Foundation in base al fatto che il progetto era troppo difficile, lei e i suoi colleghi hanno costruito un prototipo, costituito da un paio di occhiali equipaggiati con una piccola fotocamera, luci lampeggianti e una cuffia, non diversamente da una versione iniziale di Google Glass. Una seconda domanda di sovvenzione ebbe successo e, dopo essersi trasferita al MIT, lei e il suo team lavorarono per i successivi tre anni per perfezionarla e testarla in una scuola del Rhode Island. El Kaliouby lo descrive come "un progetto di ricerca e di successo" - i bambini autistici che lo hanno usato hanno avuto esperienze straordinariamente positive - ma nel 2008, alla fine della borsa, ha dovuto affrontare un momento di resa dei conti. L'interesse commerciale nel calcolo affettivo stava crescendo e voleva vederlo espandersi e prosperare; impegnarsi nello sviluppo degli occhiali lo limiterebbe a una minuscola fetta dei suoi potenziali usi. Quindi, insieme a Picard, ha respinto Affectiva, pur continuando a sperare che un'altra compagnia potesse prendere l'apparecchio acustico emozionale e portarlo sul mercato.

Quando è stata fondata Affectiva, la manciata di "membri del team" che costituivano la società hanno scelto ciascuno un valore che volevano incarnare, come "apprendimento" o "responsabilità sociale" o "divertimento". Il suo, come capo strategia e ufficiale scientifico, era "passione". La società di 20 persone è gestita come una quasi democrazia, con incontri semestrali in cui i dipendenti votano sulle priorità da perseguire nei prossimi sei mesi. Il suo ufficio ha una lavagna coperta da disegni della giovane figlia di uno dei suoi colleghi; ha un figlio di 6 anni, Adam, e una figlia di 12 anni, Jana, che vivono con lei nei sobborghi di Boston (il padre vive in Egitto). I suoi modi sono miti e premurosi; un'ora in una riunione mattutina si offre di ordinare un sandwich per un visitatore, anche se lei stessa sta saltando il pranzo. "È il Ramadan per me", dice sorridendo, "ma non è il Ramadan per te."

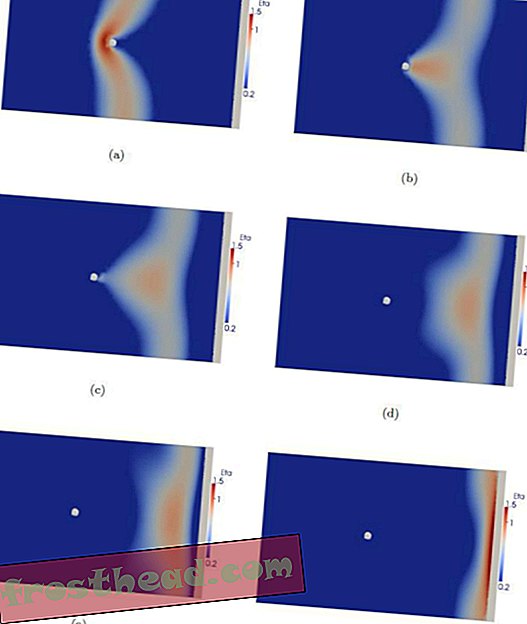

Fa sedere i visitatori su una scrivania, di fronte a un monitor e una webcam; il software individua il volto del visitatore e disegna un riquadro sullo schermo. Identifica una serie di punti da tracciare: gli angoli degli occhi e della bocca, la punta del naso e così via. Venti volte al secondo, il software cerca "unità d'azione", il gioco spesso sfuggente dei muscoli sul viso. Ce ne sono 46, secondo il sistema standard di classificazione, il Facial Action Coding System (FACS). Includono innalzatori di sopracciglia interne ed esterne, fossette, paraocchi, ammiccature e arricciature delle labbra, imbuti, pressori e succhia. Il programma standard di Affectiva campiona circa 15 di questi in qualsiasi momento e li analizza per le espressioni di sette emozioni di base: felicità, tristezza, sorpresa, paura, rabbia, disgusto e disprezzo, oltre a interesse e confusione. Sorridi e puoi vedere aumentare la misura della felicità; arriccia il labbro in un ghigno e il programma nota il tuo disgusto.

O, più precisamente, la tua espressione di disgusto. L'intera premessa del calcolo affettivo si basa su ciò che equivale a un salto di fede, che un sorriso trasmette una sensazione di felicità, piacere o divertimento. Certo, gli esseri umani sono nella stessa posizione: possiamo essere ingannati da un falso sorriso o da una finta rabbia, quindi non possiamo davvero aspettarci di più da un programma per computer, almeno non ancora.

Nel tempo Affectiva ha creato un archivio di oltre tre milioni di video di volti, caricati da utenti di Internet reclutati da circa 75 paesi in tutto il mondo. Centinaia di migliaia di questi sono stati analizzati da osservatori addestrati e codificati per le unità d'azione FACS, un'impresa monumentale, poiché i video durano in media circa 45 secondi e ciascuno richiede circa cinque volte il tempo di elaborazione. I risultati dei programmatori umani, a loro volta, sono stati utilizzati per "addestrare" gli algoritmi dell'azienda, che hanno elaborato il resto in tempo reale. L'intero database comprende ora circa 40 miliardi di "punti di dati emotivi", una risorsa, si vanta di Kaliouby, che distingue Affectiva da altre società dello stesso settore, come Emotient, con sede in California, probabilmente il suo concorrente più vicino.

(Grafico: infografica 5W; fonte: Daniel McDuff, MIT Media Lab, Affectiva)

(Grafico: infografica 5W; fonte: Daniel McDuff, MIT Media Lab, Affectiva) Daniel McDuff, che è entrato a far parte di Affectiva del MIT Media Lab e ricopre il ruolo di direttore della ricerca, studia continuamente questa ricerca per approfondire ulteriormente l'espressione delle emozioni. In che modo differiscono per età, sesso e cultura? (Forse sorprendentemente, McDuff ha scoperto che le persone anziane sono più espressive, soprattutto di emozioni positive, rispetto a quelle più giovani.) Possiamo misurare in modo affidabile disprezzo, imbarazzo, noia, ansia? Quando un solco di fronte segnala confusione e quando indica concentrazione? Come possiamo distinguere tra un'espressione di paura e una che significa sorpresa? (Suggerimento: l'unità di azione 1, il "sollevatore di sopracciglia interne", è l'indicatore della paura; l'unità di azione 2, il "sollevatore di sopracciglia esterne", indica sorpresa.) Vi è, dice, ogni ragione per credere che il programma continuerà per rilevare meglio le espressioni (anche se non può mai superare completamente il più grande ostacolo di tutti: il Botox).

Su mia richiesta, McDuff ha dato al programma uno dei grandi classici problemi di rilevazione delle emozioni, la Gioconda, il cui enigmatico quasi-sorriso ha incuriosito gli spettatori per 500 anni. Con l'avvertenza che il software funziona meglio sulle espressioni mobili, non sulle immagini statiche, ha riferito che non ha trovato alcuna prova di un sorriso genuino di La Gioconda, ma piuttosto una combinazione di unità di azione 28 (rullo labbra) e 24 (labbra premute insieme), forse suggerendo un certo livello di disagio.

**********

"Sto parlando con te adesso", dice Kaliouby, "e ti guardo per valutare il tuo interesse per quello che sto dicendo. Dovrei rallentare e spiegare di più? Dovrei andare su un altro argomento? Ora, immagina di dare un webinar a un grande gruppo che non riesco a vedere o ascoltare. Non ricevo feedback, non c'è modo di sapere se uno scherzo ha funzionato o è andato storto, se le persone sono fidanzate o annoiate. Non sarebbe bello ricevere quel feedback in tempo reale, aggregato, di momento in momento mentre procedo? ”

Interpreta una pubblicità per Jibo, un "robot sociale" disponibile per la prenotazione sul sito web di finanziamento della folla Indiegogo e sviluppato da un ex collega del MIT, Cynthia Breazeal. Simile a una lampada di lava ad alta tecnologia, Jibo si siede su un tavolo e scansiona i suoi dintorni, identificando le persone con il viso e interagendo con loro - inoltrando messaggi, inviando promemoria, facendo telefonate di routine, persino chiacchierando. Questa è un'altra potenziale applicazione per il software Affectiva — le aziende sono in trattativa — ed è “una prospettiva molto eccitante”, afferma el Kaliouby.

Emozionante per alcuni, ma la prospettiva di robot per l'elaborazione delle emozioni è allarmante per gli altri. Sherry Turkle, che ha studiato a lungo come gli umani si relazionano con i computer, avverte nel suo nuovo libro, Reclaiming Conversation: The Power of Talk in a Digital Age, sul "momento robotico", quando le macchine iniziano a sostituire la compagnia umana. Turkle crede che scienziati come El Kaliouby e il suo team possano fare quello che dicono che faranno. "Queste sono tutte persone brillanti e dotate che svolgono un lavoro brillante", afferma. E concorda sul fatto che in determinati contesti - ambienti pericolosi, come lo spazio o intorno a macchinari pesanti, in cui si desidera arruolare tutte le possibili modalità di comunicazione - il calcolo affettivo ha un ruolo da svolgere. "Ma il passo successivo", dice, "non segue affatto. Il prossimo passo è, facciamo un amico robot. Ho intervistato genitori che sono felici che i loro figli stiano parlando con Siri e penso che ciò non ci stia portando su una strada dove vogliamo andare. Ci definiamo esseri umani con i quali ci associamo e non ha senso per me formare il tuo senso di autostima in relazione a una macchina. Perché vorresti che un computer sapesse se sei triste? "

Perfino el Kaliouby è propenso a concordare sul fatto che "stiamo spendendo più tempo di quanto dovremmo con i nostri dispositivi", avendo in mente, naturalmente, sua figlia preteen, il cui sguardo si blocca sullo schermo del suo smartphone.

Ma considera irreversibile la tendenza verso una sempre maggiore connettività e pensa che, sebbene gli utenti debbano sempre optare, potremmo anche trarne il meglio. Prevede che i nostri dispositivi avranno "un chip emozionale e una suite di app che lo utilizzano in un modo che aggiunge abbastanza valore alle nostre vite che supera le preoccupazioni delle persone nella condivisione di questi dati". Traccia un'analogia con i dispositivi GPS: il calcolo affettivo può aiutaci a navigare nello spazio emotivo allo stesso modo in cui le app telefoniche ci aiutano a spostarci nello spazio fisico. "Tutti erano preoccupati per i dispositivi di rilevamento della posizione anche quando uscivano per la prima volta: stavano invadendo la nostra privacy, ci stavano seguendo costantemente", afferma. "Solo ora saremmo tutti persi senza Google Maps sui nostri telefoni. Penso che questo sarà lo stesso. "

**********