Ascolto musica solo in momenti molto specifici. Quando esco per ascoltarlo dal vivo, ovviamente. Quando cucino o lavo i piatti, faccio musica e talvolta sono presenti altre persone. Quando faccio jogging o in bicicletta da e per il lavoro lungo la pista ciclabile della West Side Highway di New York, o se sono in un'auto a noleggio nelle rare occasioni in cui devo guidare da qualche parte, ascolto da solo. E quando sto scrivendo e registrando musica, ascolto ciò su cui sto lavorando. Ma questo è tutto.

Da questa storia

[×] CHIUDI

Byrne vede la musica come la colla sociale che tiene insieme culture e comunità. (Clayton Cubitt)

Byrne vede la musica come la colla sociale che tiene insieme culture e comunità. (Clayton Cubitt)  (Clayton Cubitt)

(Clayton Cubitt)

Galleria fotografica

Trovo la musica un po 'invadente nei ristoranti o nei bar. Forse a causa del mio coinvolgimento con esso, sento di dover ascoltare attentamente o sintonizzarlo. Principalmente lo escludo; Spesso non noto nemmeno se una canzone dei Talking Heads sta suonando nella maggior parte dei luoghi pubblici. Purtroppo, la maggior parte della musica diventa (per me) un fastidioso livello sonoro che aggiunge solo rumore di sottofondo.

Man mano che la musica diventa meno di tutto - un cilindro, una cassetta, un disco - e più effimera, forse inizieremo ad assegnare un valore crescente alle esibizioni dal vivo. Dopo anni di accumulo di LP e CD, devo ammettere che ora mi sto liberando di loro. Di tanto in tanto inserisco un CD in un lettore, ma mi sono praticamente convertito completamente all'ascolto di MP3 sul mio computer o, gulp, sul mio telefono! Per me, la musica si sta smaterializzando, uno stato più veritiero della sua natura, sospetto. La tecnologia ci ha portato al punto di partenza.

Vado ad almeno una esibizione dal vivo a settimana, a volte con gli amici, a volte da sola. Ci sono altre persone lì. Spesso c'è anche la birra. Dopo oltre cento anni di innovazione tecnologica, la digitalizzazione della musica ha inavvertitamente avuto l'effetto di enfatizzare la sua funzione sociale. Non solo diamo ancora agli amici copie della musica che ci entusiasma, ma sempre più siamo arrivati a valutare l'aspetto sociale di un'esibizione dal vivo più di quanto non facessimo. La tecnologia musicale sembra in qualche modo essere stata su una traiettoria in cui il risultato finale è che si distruggerà e svaluterà se stessa. Ci riuscirà completamente quando si autodistruggerà. La tecnologia è utile e conveniente, ma alla fine ha ridotto il proprio valore e aumentato il valore delle cose che non è mai stato in grado di catturare o riprodurre.

La tecnologia ha alterato il modo in cui la musica suona, come è composta e come la viviamo. Ha anche inondato il mondo di musica. Il mondo è pieno di suoni (principalmente) registrati. Prima dovevamo pagare per la musica o farlo da soli; suonarlo, ascoltarlo e sperimentarlo è stato eccezionale, un'esperienza rara e speciale. Ora sentirlo è onnipresente e il silenzio è la rarità per cui paghiamo e gustiamo.

Il nostro godimento della musica - la nostra capacità di trovare una sequenza di suoni che influiscono emotivamente - ha delle basi neurologiche? Da un punto di vista evolutivo, ascoltare musica offre qualche vantaggio? La musica è davvero pratica, o è semplicemente il bagaglio che è stato portato avanti mentre abbiamo sviluppato altri adattamenti più ovviamente utili? Il paleontologo Stephen Jay Gould e il biologo Richard Lewontin scrissero nel 1979 un articolo in cui affermava che alcune delle nostre abilità e abilità potevano essere come dei pennacchi - gli spazi negativi architettonici sopra la curva degli archi degli edifici - dettagli che non erano originariamente progettati come entità autonome, ma ciò è nato da altri elementi più pratici che li circondano.

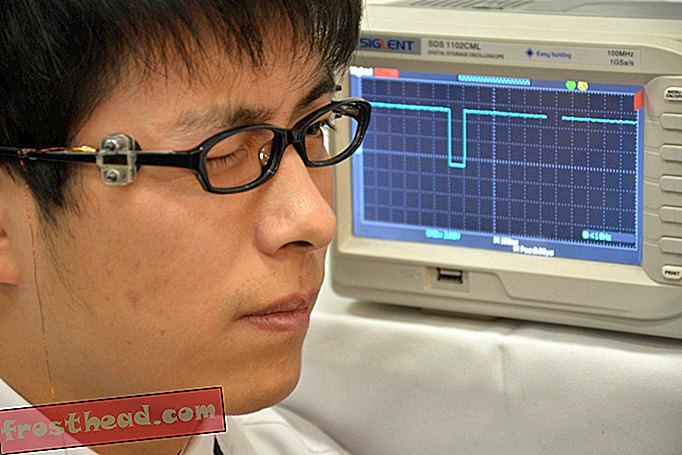

Dale Purves, professore alla Duke University, ha studiato questa domanda con i suoi colleghi David Schwartz e Catherine Howe, e pensano che potrebbero avere delle risposte. Hanno scoperto che la gamma sonora che conta e ci interessa di più è identica alla gamma di suoni che noi stessi produciamo. Le nostre orecchie e il nostro cervello si sono evoluti per cogliere sottili sfumature principalmente all'interno di quella gamma, e al di fuori di essa sentiamo meno, o spesso nulla. Non riusciamo a sentire ciò che i pipistrelli sentono o il suono subarmonico che usano le balene. Per la maggior parte, anche la musica rientra nella gamma di ciò che possiamo ascoltare. Sebbene alcune delle armoniche che danno alle voci e agli strumenti i loro suoni caratteristici siano al di là della nostra portata uditiva, gli effetti che producono non lo sono. La parte del nostro cervello che analizza i suoni in quelle frequenze musicali che si sovrappongono ai suoni che noi stessi produciamo è più ampia e sviluppata - proprio come l'analisi visiva dei volti è una specialità di un'altra parte altamente sviluppata del cervello.

Il gruppo Purves ha anche aggiunto a questo il presupposto che i suoni periodici - suoni che si ripetono regolarmente - sono generalmente indicativi di esseri viventi e quindi sono più interessanti per noi. Un suono che si ripete continuamente potrebbe essere qualcosa di cui diffidare, o potrebbe portare ad un amico, o una fonte di cibo o acqua. Possiamo vedere come questi parametri e regioni di interesse si restringano verso un'area di suoni simile a quella che chiamiamo musica. Purves ipotizzò che sembrasse naturale che il linguaggio umano influenzasse quindi l'evoluzione del sistema uditivo umano e la parte del cervello che elabora quei segnali audio. Le nostre vocalizzazioni e la nostra capacità di percepire le loro sfumature e sottigliezze, si sono evolute insieme.

In uno studio dell'UCLA, i neurologi Istvan Molnar-Szakacs e Katie Overy hanno osservato le scansioni cerebrali per vedere quali neuroni hanno sparato mentre persone e scimmie osservavano altre persone e scimmie compiere azioni specifiche o provare emozioni specifiche. Hanno determinato che una serie di neuroni nell'osservatore "rispecchia" ciò che hanno visto accadere nell'osservato. Se stai osservando un atleta, ad esempio, i neuroni associati agli stessi muscoli che l'atleta sta usando spareranno. I nostri muscoli non si muovono, e purtroppo non c'è alcun allenamento virtuale o beneficio per la salute nel guardare altre persone esercitarsi, ma i neuroni agiscono come se stessimo imitando l'osservato. Questo effetto specchio vale anche per i segnali emotivi. Quando vediamo qualcuno aggrottare le sopracciglia o sorridere, i neuroni associati a quei muscoli facciali si accendono. Ma - ed ecco la parte significativa - anche i neuroni emotivi associati a quei sentimenti sparano. Indizi visivi e uditivi innescano neuroni empatici. Sdolcinato ma vero: se sorridi renderai felici le altre persone. Sentiamo ciò che l'altro sente - forse non così fortemente, o profondamente - ma l'empatia sembra essere costruita nella nostra neurologia. È stato proposto che questa rappresentazione condivisa (come la chiamano i neuroscienziati) è essenziale per qualsiasi tipo di comunicazione. La capacità di sperimentare una rappresentazione condivisa è come sappiamo a cosa sta arrivando l'altra persona, di cosa stanno parlando. Se non avessimo questo mezzo per condividere riferimenti comuni, non saremmo in grado di comunicare.

È un po 'stupidamente ovvio, ovviamente proviamo quello che provano gli altri, almeno in una certa misura. Se non lo facessimo, perché dovremmo mai piangere al cinema o sorridere quando sentiamo una canzone d'amore? Il confine tra ciò che senti e ciò che sento è poroso. Il fatto che siamo animali sociali è profondamente radicato e ci rende ciò che siamo. Pensiamo a noi stessi come individui, ma in una certa misura non lo siamo; le nostre stesse cellule sono unite al gruppo da queste evolute reazioni empatiche verso gli altri. Questo mirroring non è solo emotivo, è anche sociale e fisico. Quando qualcuno si fa male "sentiamo" il suo dolore, anche se non collassiamo in agonia. E quando un cantante getta indietro la testa e si libera, lo capiamo anche noi. Abbiamo un'immagine interiore di ciò che sta attraversando quando il suo corpo assume quella forma.

Anticipiamo anche i suoni astratti. Possiamo leggere le emozioni quando sentiamo le orme di qualcuno. I sentimenti semplici - tristezza, felicità e rabbia - sono rilevati abbastanza facilmente. I passi possono sembrare un esempio ovvio, ma mostrano che colleghiamo tutti i tipi di suoni ai nostri presupposti su quale emozione, sensazione o sensazione abbia generato quel suono.

Lo studio dell'UCLA ha proposto che il nostro apprezzamento e sentimento per la musica siano profondamente dipendenti dai neuroni specchio. Quando guardi, o semplicemente ascolti, qualcuno suona uno strumento, i neuroni associati ai muscoli richiesti per suonare quel fuoco dello strumento. Ascoltando un piano, "sentiamo" quei movimenti di mani e braccia, e come qualsiasi chitarrista ad aria ti dirà, quando ascolti o vedi un assolo bruciante, lo stai anche "suonando". Devi saper suonare il piano per poter rispecchiare un pianista? Edward W. Large alla Florida Atlantic University scansionò il cervello delle persone con e senza esperienza musicale mentre ascoltavano Chopin. Come si può immaginare, il sistema dei neuroni specchio si è acceso nei musicisti che sono stati testati, ma in qualche modo sorprendentemente, è balenato anche nei non musicisti. Quindi, suonare la chitarra aerea non è così strano come a volte sembra. Il gruppo UCLA sostiene che tutti i nostri mezzi di comunicazione - uditivi, musicali, linguistici, visivi - hanno attività motorie e muscolari alla radice. Leggendo e intuendo le intenzioni dietro quelle attività motorie, ci connettiamo con le emozioni sottostanti. Il nostro stato fisico e il nostro stato emotivo sono inseparabili: percependo l'uno, un osservatore può dedurre l'altro.

Anche le persone ballano alla musica e il mirroring neurologico potrebbe spiegare perché ascoltare la musica ritmata ci ispira a muoverci e a muoverci in modi molto specifici. La musica, più di molte altre arti, innesca tutta una serie di neuroni. Molteplici regioni del cervello si accendono all'ascolto della musica: muscolare, uditiva, visiva, linguistica. Ecco perché alcune persone che hanno perso completamente le loro abilità linguistiche possono ancora articolare un testo quando viene cantato. Oliver Sacks ha scritto di un uomo con un danno cerebrale che ha scoperto che poteva cantare attraverso le sue banali routine quotidiane e solo così poteva ricordare come portare a termine compiti semplici come vestirsi. La terapia di intonazione melodica è il nome di un gruppo di tecniche terapeutiche basate su questa scoperta.

Anche i neuroni specchio sono predittivi. Quando osserviamo un'azione, una postura, un gesto o un'espressione facciale, abbiamo una buona idea, basata sulla nostra esperienza passata, su ciò che verrà dopo. Alcuni sullo spettro di Asperger potrebbero non intuire tutti quei significati con la stessa facilità degli altri, e sono sicuro di non essere il solo ad essere stato accusato di perdere ciò che gli amici pensavano fossero segnali o segnali evidenti. Ma la maggior parte delle persone ne cattura almeno una grande percentuale. Forse il nostro innato amore per la narrativa ha delle basi predittive e neurologiche; abbiamo sviluppato la capacità di essere in grado di sentire dove potrebbe andare una storia. Idem con una melodia. Potremmo avvertire l'ascesa e la caduta emotivamente risonanti di una melodia, una ripetizione, una costruzione musicale e abbiamo aspettative, basate sull'esperienza, su dove queste azioni stanno conducendo - aspettative che saranno confermate o leggermente reindirizzate a seconda del compositore o esecutore . Come sottolinea lo scienziato cognitivo Daniel Levitin, troppe conferme - quando succede qualcosa esattamente come prima - ci fanno annoiare e mettere a punto. Piccole variazioni ci mantengono vigili, oltre a servire ad attirare l'attenzione su momenti musicali che sono fondamentali per la narrazione.

La musica ci fa così tante cose che non si può semplicemente dire, come molti fanno: "Oh, amo tutti i tipi di musica". Davvero? Ma alcune forme di musica sono diametralmente opposte l'una all'altra! Non puoi amarli tutti. Non sempre, comunque.

Nel 1969, l'Unesco ha approvato una risoluzione che delinea un diritto umano di cui non si parla molto: il diritto al silenzio. Penso che si riferiscano a ciò che accade se una fabbrica rumorosa viene costruita accanto a casa tua, o un poligono di tiro, o se una discoteca si apre al piano di sotto. Non significano che puoi chiedere a un ristorante di spegnere le classiche melodie rock che sta suonando, o che puoi mettere la museruola al ragazzo accanto a te sul treno urlando sul suo cellulare. È un bel pensiero però — nonostante la nostra innata paura del silenzio assoluto, dovremmo avere il diritto di fare una pausa uditiva occasionale, per sperimentare, per quanto brevemente, un momento o due di aria fresca sonora. Avere un momento meditativo, uno spazio per liberare la testa, è una bella idea per un diritto umano.

John Cage scrisse un libro intitolato, un po 'ironicamente, Silence . Ironico perché stava diventando sempre più famoso per il rumore e il caos nelle sue composizioni. Una volta ha affermato che il silenzio non esiste per noi. Nel tentativo di sperimentarlo, entrò in una camera anecoica, una stanza isolata da tutti i suoni esterni, con pareti progettate per inibire il riflesso dei suoni. Uno spazio morto, acusticamente. Dopo qualche istante sentì un tonfo e un frastuono e fu informato che quei suoni erano il battito del suo cuore e il suono del suo sangue che scorreva nelle sue vene e arterie. Erano più rumorosi di quanto si sarebbe potuto aspettare, ma va bene. Dopo un po 'sentì un altro suono, un forte gemito, e fu informato che questo era il suo sistema nervoso. Comprese quindi che per gli esseri umani non esisteva il vero silenzio, e questo aneddoto divenne un modo per spiegare che, piuttosto che combattere per chiudere i suoni del mondo, per compartimentare la musica come qualcosa al di fuori del rumore, incontrollabile mondo di suoni, li lasciava entrare: "Lascia che i suoni siano se stessi piuttosto che i veicoli per le teorie o espressioni artificiali dei sentimenti umani". Almeno concettualmente, il mondo intero ora è diventato musica.

Se la musica è inerente a tutte le cose e in tutti i luoghi, allora perché non lasciare che la musica suoni da sola? Il compositore, nel senso tradizionale, potrebbe non essere più necessario. Lascia girare i pianeti e le sfere. Il musicista Bernie Krause è appena uscito con un libro sulla "biofonia", il mondo della musica e dei suoni prodotti da animali, insetti e ambiente non umano. La musica prodotta da sistemi auto-organizzati significa che chiunque o qualsiasi cosa può farcela e chiunque può allontanarsene. John Cage ha affermato che il compositore contemporaneo "assomiglia al creatore di una macchina fotografica che consente a qualcun altro di scattare la foto". È una specie di eliminazione della paternità, almeno nel senso accettato. Sentiva che la musica tradizionale, con le sue partiture che indicavano quale nota suonare e quando, non sono riflessi dei processi e degli algoritmi che attivano e creano il mondo che ci circonda. Il mondo in effetti ci offre possibilità e opportunità limitate, ma ci sono sempre opzioni e più di un modo in cui le cose possono rivelarsi. Lui e altri si chiedevano se forse la musica potesse prendere parte a questo processo emergente.

Un piccolo dispositivo realizzato in Cina porta questa idea un passo avanti. Buddha Machine è un lettore musicale che utilizza algoritmi casuali per organizzare una serie di toni rilassanti e quindi creare melodie senza fine e non ripetitive. Il programmatore che ha realizzato il dispositivo e organizzato i suoi suoni sostituisce il compositore, senza lasciare alcun esecutore. Il compositore, lo strumento e l'esecutore sono tutti una macchina. Questi non sono dispositivi molto sofisticati, sebbene si possa immaginare un giorno in cui tutti i tipi di musica potrebbero essere generati automaticamente. I modelli di base comunemente usati che si verificano in vari generi potrebbero diventare gli algoritmi che guidano la produzione di suoni. Si potrebbe vedere gran parte del pop e dell'hip-hop aziendale come prodotti da macchine: le loro formule sono ben definite e si deve solo scegliere tra una varietà di hook e beat disponibili, ed emerge un flusso ricombinante infinito di musica radio-friendly. Sebbene questo approccio industriale sia spesso disapprovato, la sua natura artificiale potrebbe anche essere un complimento: restituisce la paternità musicale all'etere. Tutti questi sviluppi implicano che siamo tornati al punto di partenza: siamo tornati all'idea che il nostro universo potrebbe essere permeato di musica.

Accolgo con favore la liberazione della musica dal carcere di melodia, struttura rigida e armonia. Perchè no? Ma ascolto anche musica che rispetta queste linee guida. Ascoltare la musica delle sfere potrebbe essere glorioso, ma ogni tanto bramo una canzone concisa, una narrazione o un'istantanea più di un intero universo. Posso godermi un film o leggere un libro in cui non succede molto, ma sono anche profondamente conservatore: se una canzone si afferma nel genere pop, allora ascolto con certe aspettative. Posso annoiarmi più facilmente con una canzone pop che non suona secondo le sue stesse regole che con una composizione contemporanea ripetitiva e statica. Mi piace una bella storia e mi piace anche guardare il mare: devo scegliere tra i due?

Estratto da How Music Works di David Byrne, pubblicato da McSweeney's Books, © 2012 di Todo Mundo Ltd.